اگر اخبار هوش مصنوعی یا اخبار فناوری را دنبال کنید، احتمالاً تاکنون درباره DeepSeek شنیدهاید، مدل زبان بزرگ چینی که توانمندیهایی مشابه ChatGPT دارد و در عین حال هزینههای آموزش آن به طور چشمگیری کمتر است. DeepSeek برای استدلال پیشرفته، تواناییهای زبان طبیعی و چت بات، مهارت در انجام وظایف، تحقیق و همچنین برای کدنویسی، تولید کد و منطق طراحی شده است، که آن را به ابزاری قدرتمند برای هوش مصنوعی و به طور کلی برای جریان کار شما تبدیل میکند. در حالی که میتوانید از DeepSeek در هر جایی از طریق وب استفاده کنید و همچنین میتوانید آن را از طریق اپلیکیشن بر روی آیفون یا آیپد خود با استفاده از Cloud DeepSeek دانلود و اجرا کنید، گزینه دیگری برای کاربران مک وجود دارد: اجرای DeepSeek LLM به صورت محلی روی مک خود.

اجرای DeepSeek به صورت محلی میتواند برای بسیاری از کاربران مک مفید باشد، چه شما یک توسعهدهنده، محقق یا فردی باشید که فقط کنجکاو است تا از ابزارهای هوش مصنوعی و LLM استفاده کند. یکی از مهمترین مزایای استفاده و اجرای DeepSeek به صورت محلی این است که به صورت آفلاین عمل میکند، به شما امکان میدهد از مزایای DeepSeek LLM بدون وابستگی به خدمات ابری (که به چین مرتبط هستند، هر طور که آن را تفسیر کنید) بهرهمند شوید و حریم خصوصی بیشتری را فراهم میکند و پتانسیل سفارشیسازی و تنظیم مدل برای موارد خاص شما را میدهد.

برای اجرای DeepSeek به صورت محلی، باید یک مک با چیپ Apple Silicon داشته باشید. در این مقاله، از یک ابزار رایگان برای مک به نام LM Studio استفاده خواهیم کرد تا بتوانید به سرعت DeepSeek را روی مک خود راهاندازی و استفاده کنید. در حالی که همه این مراحل ممکن است پیچیده به نظر برسند و فناوری هوش مصنوعی و LLM میتواند برای تازهکاران دلهرهآور باشد، این فرایند راهاندازی در واقع بسیار ساده است و ما شما را از طریق آن راهنمایی خواهیم کرد.

چگونه DeepSeek را به صورت محلی روی مک اجرا کنیم

دوباره باید یک مک با چیپ Apple Silicon (چیپ M-series یا بهتر) داشته باشید تا بتوانید DeepSeek را به صورت محلی اجرا کنید. اگرچه این الزامات نرمافزاری سختگیرانه است، اما این استاندارد برای اجرای هر مدل محلی دیگر، از جمله Apple Intelligence، ChatGPT، Llama یا هر ابزار LLM دیگری که به طور فزایندهای رایج شده است، است. همچنین باید حداقل ۱۰ گیگابایت فضای دیسک در دسترس داشته باشید. اگر مک با Apple Silicon ندارید، هنوز میتوانید از ابزارهای هوش مصنوعی از طریق آیفون یا آیپد خود با استفاده از اپلیکیشنهای مختلف، یا هر مک دیگری از طریق وب استفاده کنید. برای اهداف ما در اینجا، فرض میکنیم که شما یک مک با Apple Silicon دارید، که در این صورت در ادامه روش اجرای DeepSeek به صورت محلی آورده شده است:

- دانلود LMStudio رایگان از lmstudio.ai

به وبسایت lmstudio.ai بروید و LMStudio را به صورت رایگان دانلود کنید. - نصب LMStudio

پس از دانلود، فایل تصویر دیسک LMStudio را مونت (mount) کرده و اپلیکیشن ‘LM Studio’ را از تصویر دیسک به پوشه Applications خود کپی کنید تا آن را نصب کنید. سپس، LM Studio را مستقیماً از پوشه Applications خود اجرا کنید. - اجرای اولیه LMStudio

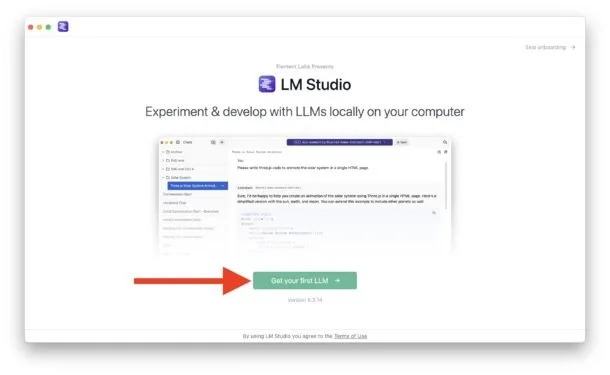

هنگام اولین اجرا، صفحه راهاندازی (onboarding) به شما نمایش داده میشود. روی دکمه سبز رنگ که نوشته “Get your first LLM” کلیک کنید.

- تنظیم DeepSeek به صورت محلی روی مک

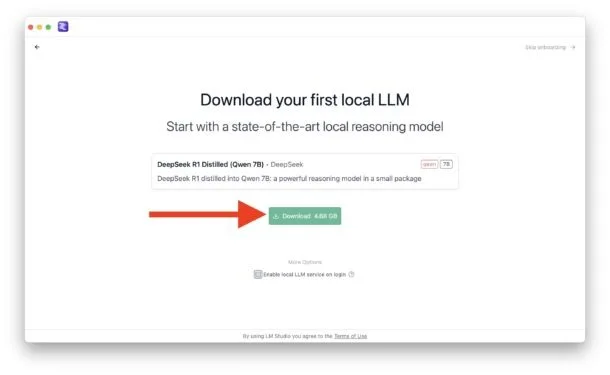

در صفحه “دانلود اولین مدل LLM محلی خود”، روی دکمه سبز رنگ “Download” کلیک کنید. (در صورت تمایل، میتوانید گزینه “Enable local LLM service on login” را لغو کنید تا هر بار که مک خود را راهاندازی میکنید، دیمون (daemon) برای DeepSeek اجرا نشود.)

- دانلود DeepSeek به صورت محلی روی مک

به DeepSeek اجازه دهید تا دانلود شود. حجم آن چند گیگابایت است و ممکن است مدتی طول بکشد. پس از اتمام دانلود، DeepSeek به صورت محلی آماده استفاده روی مک شما خواهد بود.

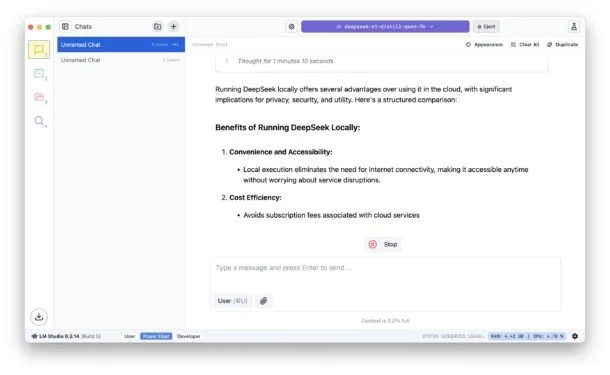

حالا میتونید آزادانه از DeepSeek بهصورت محلی روی مک خودتون استفاده کرده و باهاش تعامل داشته باشید.

اگر میخواید مطمئن بشید که تجربه شما کاملاً محلیه، کافیه وایفای رو خاموش یا ارتباط اینترنتتون رو قطع کنید. خواهید دید که همچنان میتونید با LM Studio و DeepSeek کار کنید، بدون نیاز به اینترنت.

چیزی که احتمالاً متوجه میشید اینه که اجرای هر مدل زبانی بزرگ (LLM) بهصورت محلی معمولاً کندتر از نسخههای مبتنی بر فضای ابریه. دلیلش اینه که مدلهای ابری توسط سرورهای بسیار قدرتمند اجرا میشن، در حالی که وقتی بهصورت محلی اجرا میکنید، عملکرد مدل محدود به سختافزار مک شماست؛ شامل پردازنده، حافظه رم، و برنامههای در حال اجرا. اگه اولویت شما فقط سرعت و کارایی باشه، استفاده از نسخههای ابری منطقیتره—گرچه مکهای جدید و قدرتمند هم سرعت خوبی دارن.

از طرفی، LM Studio این امکان رو به شما میده که علاوه بر DeepSeek، مدلهای دیگه مثل Llama، Mistral و Phi رو هم بهصورت محلی روی مک اجرا کنید. البته اینجا تمرکز ما روی DeepSeek هست. قبلاً هم درباره اجرای مدلهایی مثل Llama (حتی نسخههای بدون فیلترش) روی مک صحبت کردیم، ولی روش اجرای DeepSeek (و سایر مدلها در صورت علاقه) واقعاً سادهست و عملکرد خوبی هم داره. تشکر از CultOfMac بابت ایده و الهام.

کلاینتهایی مثل Perplexity و ابزارهای هوش مصنوعی دیگهای هم وجود دارن که بسیار جالب هستن. این جدای از گزینههای تحت وب یا اپلیکیشنیه مثل Bing با ChatGPT، گوگل Gemini، Grok از X (توییتر سابق)، Llama از فیسبوک، و خیلیهای دیگه.